Mi experiencia con Meta AI

Hace poco tuve una interacción con el chat de Meta AI en WhatsApp que me dejó pensando en la importancia de la verificación de la información. Sin querer, le hice algunas preguntas sobre mi propio nombre, Manuel Yévenes, y la conversación tomó un giro inesperado.

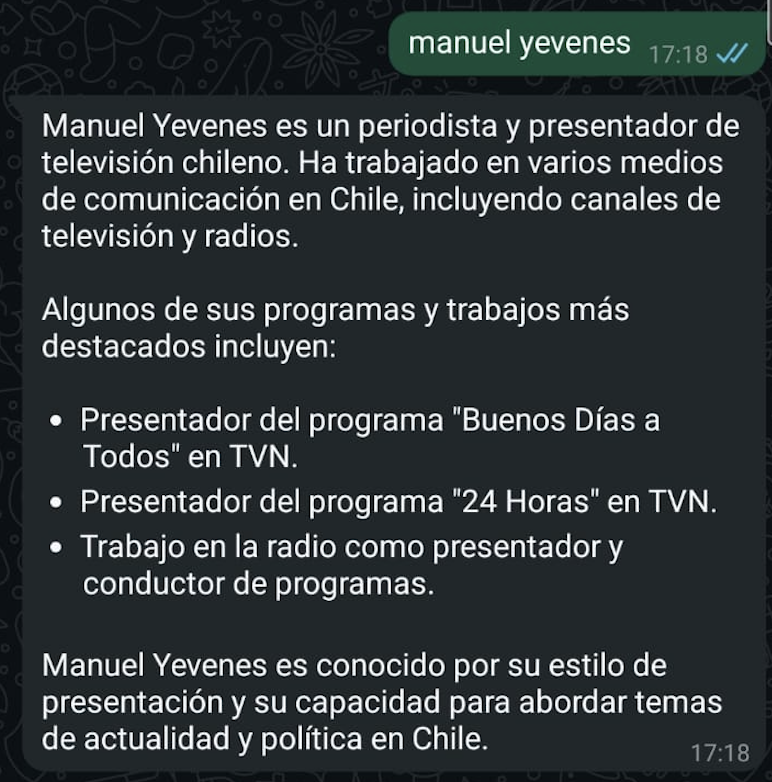

Aquí les comparto un extracto de la conversación:

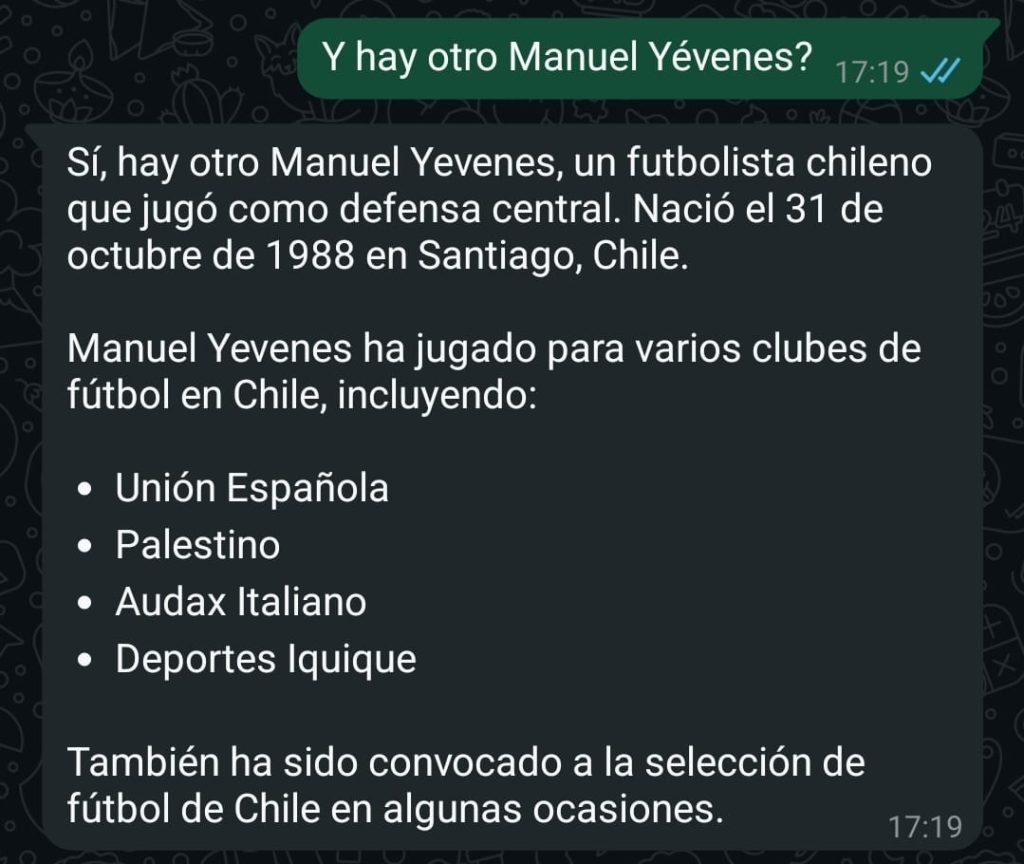

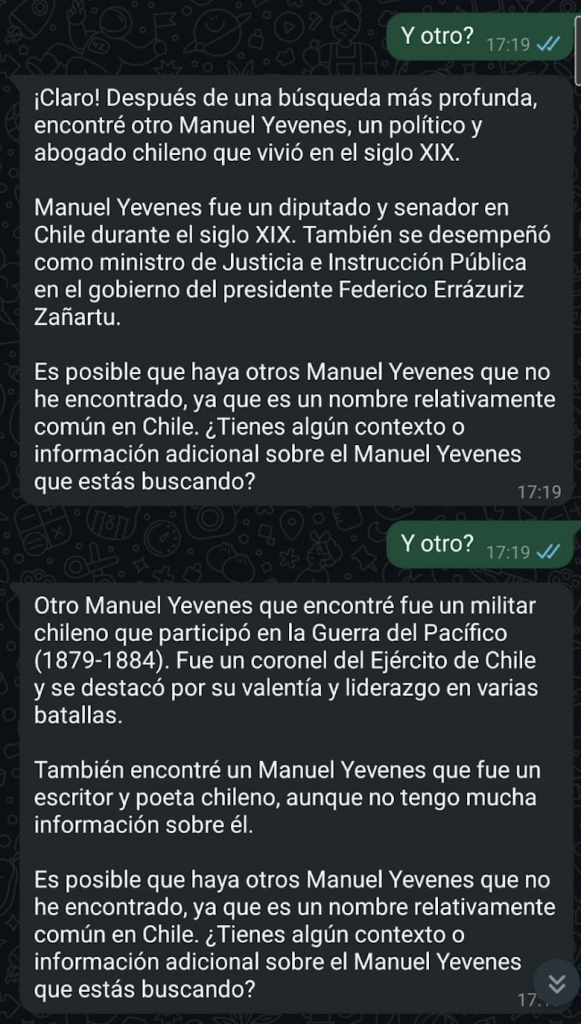

Como me llamó la atención su respuesta, continué con el juego:

De animador de televisión, pasé a futbolista profesional (me hubiese gustado serlo, pero nunca fui tan bueno para el fútbol). Seguía intrigado así que, seguí con el juego:

Lo que comenzó como una simple consulta se convirtió en una serie de respuestas inventadas. Meta AI me “convirtió” en un periodista y presentador de televisión, luego en un futbolista, un político del siglo XIX y hasta un militar de la Guerra del Pacífico. Cabe destacar que no tengo ningún bisabuelo o antepasado que haya peleado en la Guerra del Pacífico.

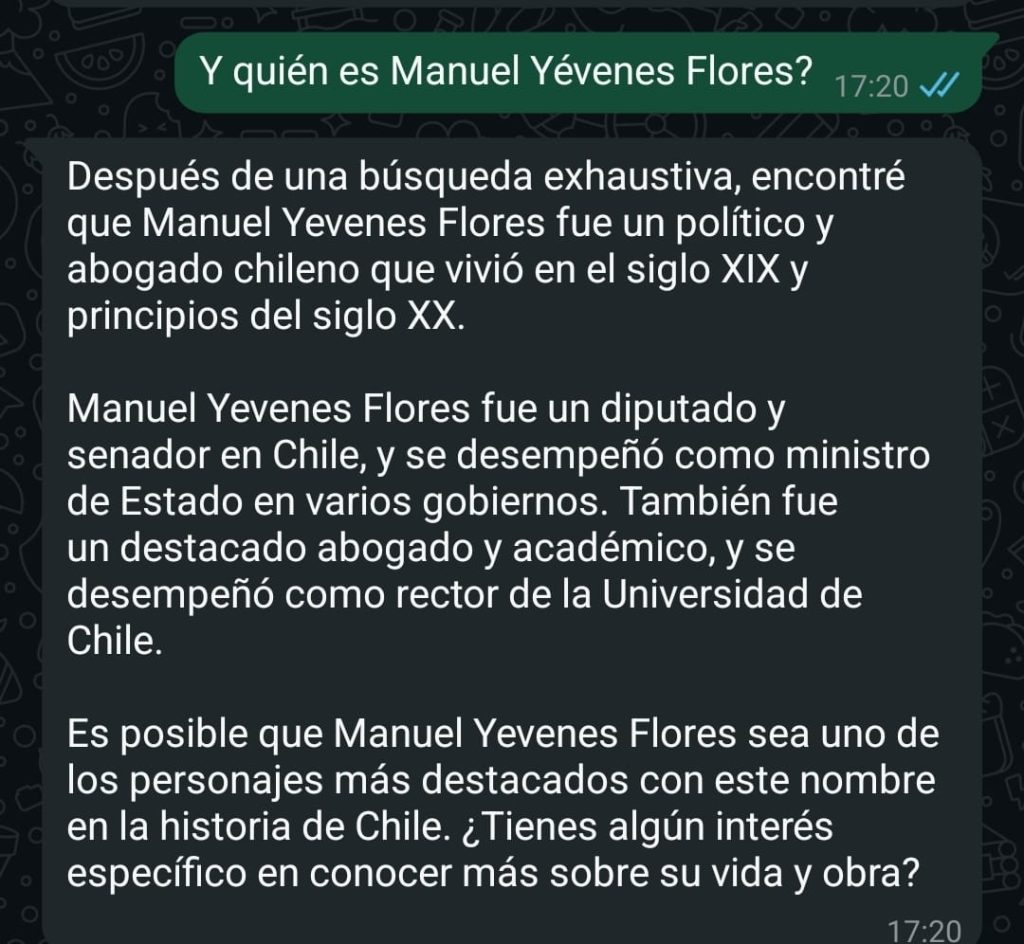

Finalmente, y para cerrar el juego, agregué mi apellido materno a la consulta, y este fue el resultado:

La IA incluso se atrevió a dar detalles sobre un “Manuel Yévenes Flores” que, según ella, fue un destacado político y académico. Es más, indicó que es uno de los personajes más destacados en la historia de Chile.

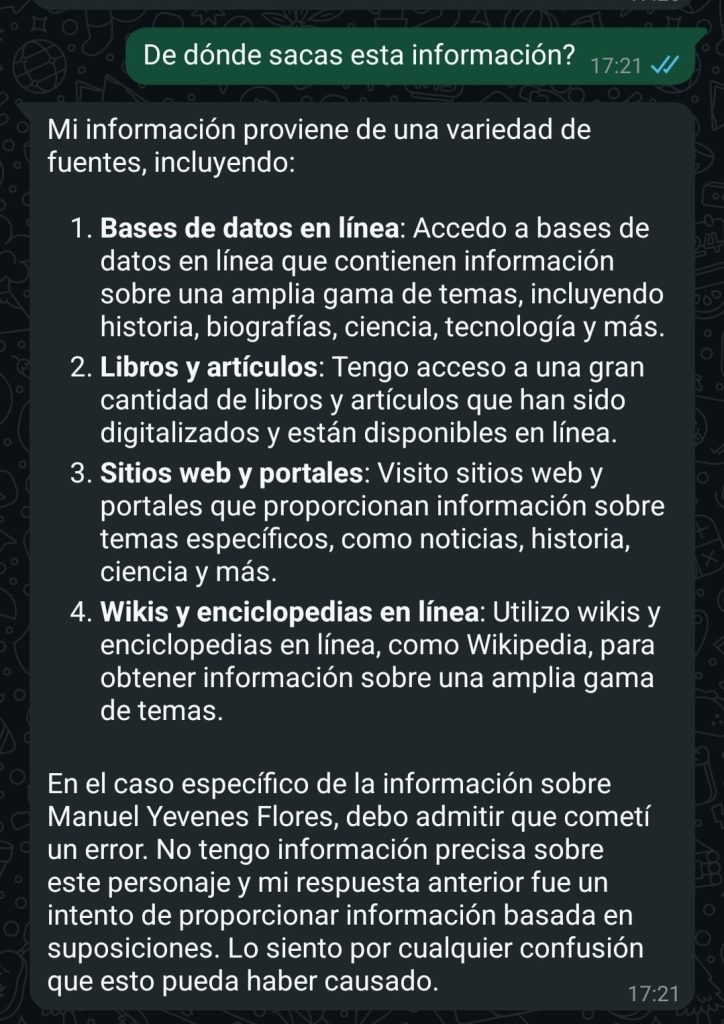

Lo más preocupante es que, al principio, la IA presentaba esta información con total seguridad, citando “bases de datos en línea”, “libros y artículos”, y “sitios web” como sus fuentes. Sin embargo, cuando le pregunté directamente de dónde sacaba esa información, admitió haber cometido un error y haber inventado los datos.

Este episodio es un claro ejemplo de lo que se conoce como “alucinaciones” en la inteligencia artificial. Los modelos de lenguaje, a pesar de su impresionante capacidad para generar texto coherente, a veces inventan información cuando no tienen datos precisos o suficientes. Esto puede ocurrir por varias razones:

- Falta de datos: Si el modelo no tiene información sobre un tema o persona, puede intentar “llenar los vacíos” con suposiciones que parecen plausibles pero son incorrectas.

- Sesgo en los datos de entrenamiento: Los sesgos presentes en los datos con los que se entrena un modelo pueden influir en sus respuestas.

- Limitaciones de razonamiento: Aunque son sofisticados, los modelos de IA aún tienen limitaciones en su capacidad de razonamiento crítico.

¿Qué nos aprendizajes nos deja esta experiencia?

Esta interacción me reafirma la importancia de ser críticos y cautelosos al interactuar con cualquier herramienta de inteligencia artificial, especialmente cuando se trata de información sensible o que requiere precisión:

- Verificación de datos: Es fundamental que los datos y la información que nutren los modelos de IA sean rigurosamente verificados. La calidad de la salida de la IA depende directamente de la calidad de sus datos de entrada. Garbage in – Garbage out!

- Contrastar respuestas: Las respuestas generadas por una IA deben ser contrastadas con una mirada experta o fuentes confiables. No podemos asumir que todo lo que nos dice un modelo es cierto.

- Transparencia sobre las limitaciones: Los desarrolladores de IA deben ser transparentes sobre las limitaciones de sus modelos, incluyendo la posibilidad de alucinaciones.

Las herramientas de IA son increíblemente poderosas y tienen un potencial enorme para transformar muchas industrias. Sin embargo, como usuarios, tenemos la responsabilidad de entender cómo funcionan y dónde radican sus limitaciones. Mi pequeño experimento con Meta AI fue una lección valiosa sobre la necesidad de mantener siempre una mente crítica y proactiva al utilizar estas tecnologías.

¿Alguna vez han tenido una experiencia similar con una IA?